-

[DL] Neural Nets for XORAI 2019. 12. 11. 18:48

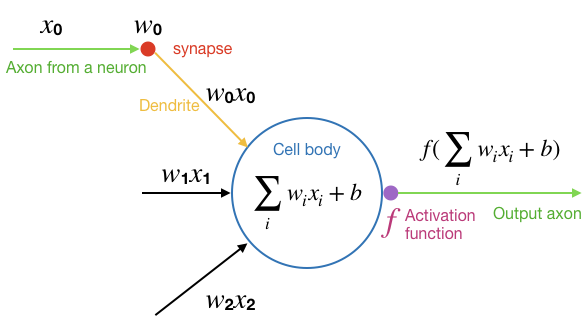

Activation Function

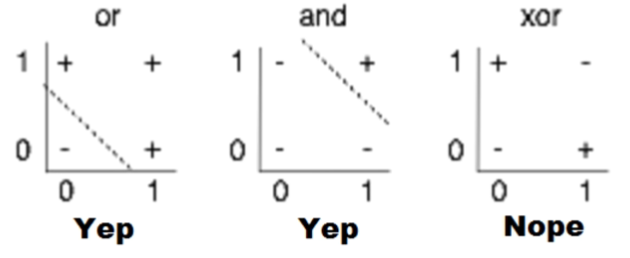

Activation Function Architecture simple AND/OR problem : linearly separable?

하나의 unit으로 And / Or 문제는 해결할 수 있지만 Xor 문제는 해결할 수 없다.

Perceptrons ( multilayer neural nets )

Base Concept

-

1957년 처음 고안된 알고리즘인 퍼셉트론은 인공 신경망 모형의 하나이다.

출처: https://www.slideshare.net/jbhuang/lecture-29-convolutional-neural-networks-computer-vision-spring2015 -

다수의 Input을 입력받아서 하나의 Output을 출력한다. 뉴런의 전기신호 역할을 하는 것이 퍼셉트론의 weight이며, 각각의 입력신호에 부여되어 입력신호와의 계산을 하고 신호의 총합이 정해진 임계값 θ를 넘었을 때 1을 출력한다. 넘지 못하면 0 또는 -1을 출력한다.

-

각 입력신호에는 고유한 weight가 부여되며 weight가 클수록 해당 신호가 중요하다고 볼 수 있고, 여기서 기계학습은 weight의 값을 정하는 작업이라고 할 수 있다.

-

퍼센트론의 출력 값은 1 또는 0(or -1)이기 때문에 linear classifier 모형이라고 볼 수 있다.

How to Learning?

-

처음 학습이 시작할 때는 임의로 설정된 weight으로 시작하며, 학습 데이터를 퍼센트론 모형에 입력하며 분류가 잘못되었을 때 weight를 개선해 나간다.

출처: https://www.slideshare.net/Nicolas_Nicolov/machine-learning-14528792 -

퍼셉트론은 모든 학습 데이터를 정확히 분류시킬 때까지 학습이 진행되기 때문에 학습 데이터가 선형적으로 분리될 수 있을 때 적합한 알고리즘이다.

Weight & Bias

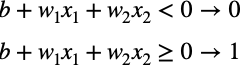

theta를 -b로 치환하여 좌변으로 넘겼을 때의 수식 -

Bias는 학습 데이터이 가중치와 계산되어 넘어야 하는 임계점으로 이 값이 높으면 높을 수록 분류의 기준이 엄격해지는 것을 의미한다.

-

Bias가 높을 수록 모델이 간단해지는 경향이 있으며 오히려 underfitting의 위험이 발생할 수 있다.

-

Bias가 낮게 되면 Overfitting의 위험이 있고 노이즈가 포함될 가능성 또한 높다.

-

Bias에 따른 변화를 Variance와 Bias의 트레이드오프 관계라고 부른다.

Limit

-

선형으로 분류를 할 수 있지만 단일 선형 분류만 가능하며 XOR과 같은 다중 선형 분류와 비선형 분류는 불가능하다는 점

-

위의 한계점은 단층 퍼셉트론의 경우에 해당하며 다층 퍼셉트론을 통해 이러한 한계점을 극복할 수 있다.

출처: http://ecee.colorado.edu/~ecen4831/lectures/NNet3.html

Backpropagation (역전파)

Concept

- Artificial Neural Network를 학습시키기 위한 일반적인 알고리즘 중 하나이다.

- 얻고자 하는 Target값과 실제 모델이 계산한 output이 얼마나 차이가 나는지 구한 후 그 오차값을 다시 뒤로 전파해가면서 각 노드가 가지고 있는 변수들을 결과 값에 대한 기여도를 기반으로 갱신하는 알고리즘이다. ( = Weight & Bias 찾기 )

Chain Rule

참고 : https://evan-moon.github.io/2018/07/19/deep-learning-backpropagation/

'AI' 카테고리의 다른 글

[DL] Dropout (0) 2019.12.27 [ML] Logistic Regression (Classification) (0) 2019.12.11 [ML] Linear Regression (0) 2019.12.11 머신러닝의 개념과 용어 (0) 2019.12.09 Nvidia Driver & CUDA install (0) 2019.10.01 -